Alibaba tocmai și-a anunțat oficial cel mai recent model de raționament și se pare că DeepSeek și OpenAI au un motiv de îngrijorare – dacă toată „hype-ul” lui Alibaba este adevărat. Acest model este open source, astfel încât toată lumea îl poate accesa și experimenta gratuit.

Denumit QwQ-32b (Quan-with-Questions), noul model AI al Alibaba rulează cu mult mai puțini parametri decât aproape toate modelele de limbaj majore de astăzi, ceea ce înseamnă că necesită mai puține resurse. Alibaba susține că QwQ-32b funcționează la același nivel cu o1-mini de la DeepSeek sau OpenAI.

Modelul de limbă mare (LLM) DeepSeek-R1 a făcut furori când a fost lansat la începutul lunii februarie, provocând standardul de aur stabilit de ChatGPT, dar la un cost de operare mult mai mic. Cu QwQ-32b, se pare că Alibaba vrea să depășească această limită și mai mult.

Din punct de vedere tehnic, DeepSeek-R1 necesită 671 de miliarde de parametri pentru a rula, cu 37 de miliarde de parametri activați. Între timp, QwQ-32b de la Alibaba are nevoie de doar 32 de miliarde de parametri. Aceste numere pot părea abstracte pentru mulți, dar fac o diferență uriașă în puterea de calcul: în timp ce DeepSeek-R1 necesita 1600 GB de VRAM pentru a rula, QwQ-32b are nevoie doar de 24 GB de VRAM. În cele mai multe cazuri, aceasta va necesita o placă grafică precum Nvidia H100 sau echivalent, dar chiar și RTX 4090, prietenos cu jucătorii, are 24 GB de VRAM. Cel mai recent RTX 5090 ridică acest număr la 32 GB.

Se susține chiar că, chiar și cu doar 32 de miliarde de parametri, QwQ-32B oferă încă performanțe egale sau superioare cu R1 în domenii precum matematica, programarea și rezolvarea generală a problemelor. Alibaba a mai spus că QwQ-32B depășește o performanță OpenAI o1-mini, care este construit cu 100 de miliarde de parametri. QwQ-32B este disponibil pe Hugging Face, cea mai mare comunitate de modele AI open source din lume.

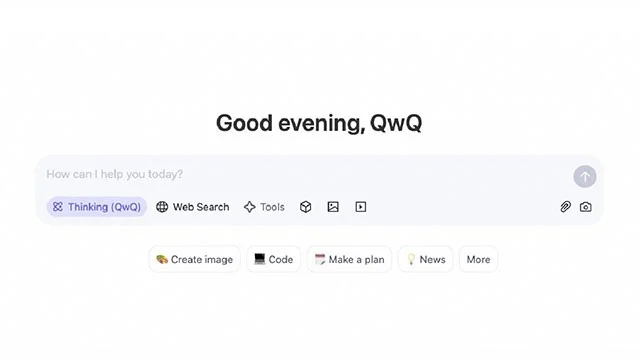

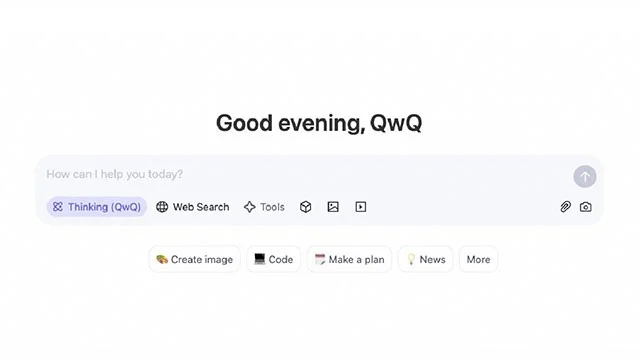

QwQ-32b de la Alibaba este disponibil sub licența Apache 2.0, ceea ce înseamnă că companiile și cercetătorii îl pot folosi liber. Mai important, îl putem încerca prin Qwen Chat de la Alibaba. La fel ca DeepSeek, QwQ-32b are unele limitări în ceea ce privește limitele subiectului. De exemplu, când este întrebat despre probleme politice, Qwen Chat va transmite un mesaj că acesta este un subiect nepotrivit. Dar există și câteva avantaje care sunt imediat evidente.

QwQ-32b pare să ofere răspunsuri destul de detaliate chiar și la întrebări rapide și simple. Acest lucru poate fi bun, dar într-un fel, este destul de enervant, deoarece oferă o mulțime de informații inutile pe care nu le-ați cerut. Un plus este că QwQ-32b poate afișa întregul proces de raționament, similar cu caracteristica Deep Thinking a ChatGPT - dar cu mai puțină profunzime.

Rămâne de văzut dacă afirmațiile Alibaba se vor îndeplini, dar se pare că ChatGPT și DeepSeek au acum un nou concurent demn.