OpenAI a introdus recent un instrument AI de generare video numit „Sora” pentru utilizatorii ChatGPT Plus și Pro. Dar acesta nu este primul instrument de acest gen. De fapt, acum există o mulțime de servicii care sprijină crearea de videoclipuri bazate pe inteligență artificială extrem de rapid. Aceștia devin treptat un asistent puternic pentru creatori, dar uneori confuz pentru spectatori, deoarece este adesea dificil să se determine ce videoclipuri sunt reale sau ce clipuri sunt create de AI.

Pe măsură ce piața creării de videoclipuri AI crește rapid pe zi ce trece, detectarea online a videoclipurilor false sau generate de AI devine din ce în ce mai dificilă. Pentru a ajuta la rezolvarea acestei probleme, Meta a introdus un instrument de filigran numit „Meta Video Seal”, care funcționează prin adăugarea unui filigran la conținutul video generat de AI.

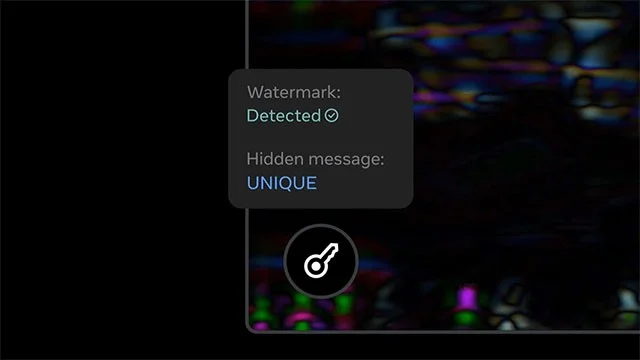

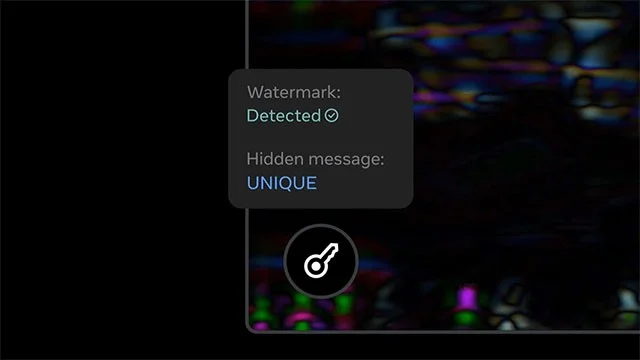

Potrivit Meta, adăugarea de filigrane la videoclipurile generate de AI nu va avea un impact prea mare asupra experienței utilizatorului. Filigranele pot fi, de asemenea, încorporate direct, fără a afecta aspectul general al videoclipului. În plus, Video Seal poate adăuga și mesaje ascunse la videoclipuri, care pot fi apoi detectate pentru a urmări originea videoclipului.

Caracteristica specială a „Meta Video Seal” este capacitatea sa de a „rezista” eforturilor obișnuite de editare video, inclusiv algoritmilor de estompare, decupare sau compresie pentru partajarea online mai ușoară. Aceasta înseamnă că, dacă cineva editează un videoclip care conține un filigran folosind Meta Video Seal, filigranul va rămâne intact, ajutând la verificarea autenticității și originii videoclipului.

Meta implementează instrumentul sub o licență autorizată, împreună cu documentația de instruire și codul de inferență. Există, de asemenea, o demonstrație interactivă, astfel încât oricine poate încerca modelul.

„Deși instrumentele AI pot ajuta la apropierea lumii, este important să implementăm măsuri de protecție pentru a reduce riscul de imitare, manipulare și alte forme de utilizare abuzivă care le-ar putea submina beneficiile”, a spus Meta. „Videoclipurile generate de AI „Watermarking” reprezintă un pas important către o mai bună trasabilitate pentru conținutul și modelele AI.”

Cu Video Seal, Meta își propune să îngreuneze actorii răi să exploateze AI pentru a răspândi știri false. În timp ce AI poate face lucruri uimitoare și poate face conținutul util mai accesibil, există, de asemenea, anumite bariere care trebuie să existe pentru a se asigura că informațiile exacte sunt disponibile pentru toată lumea.